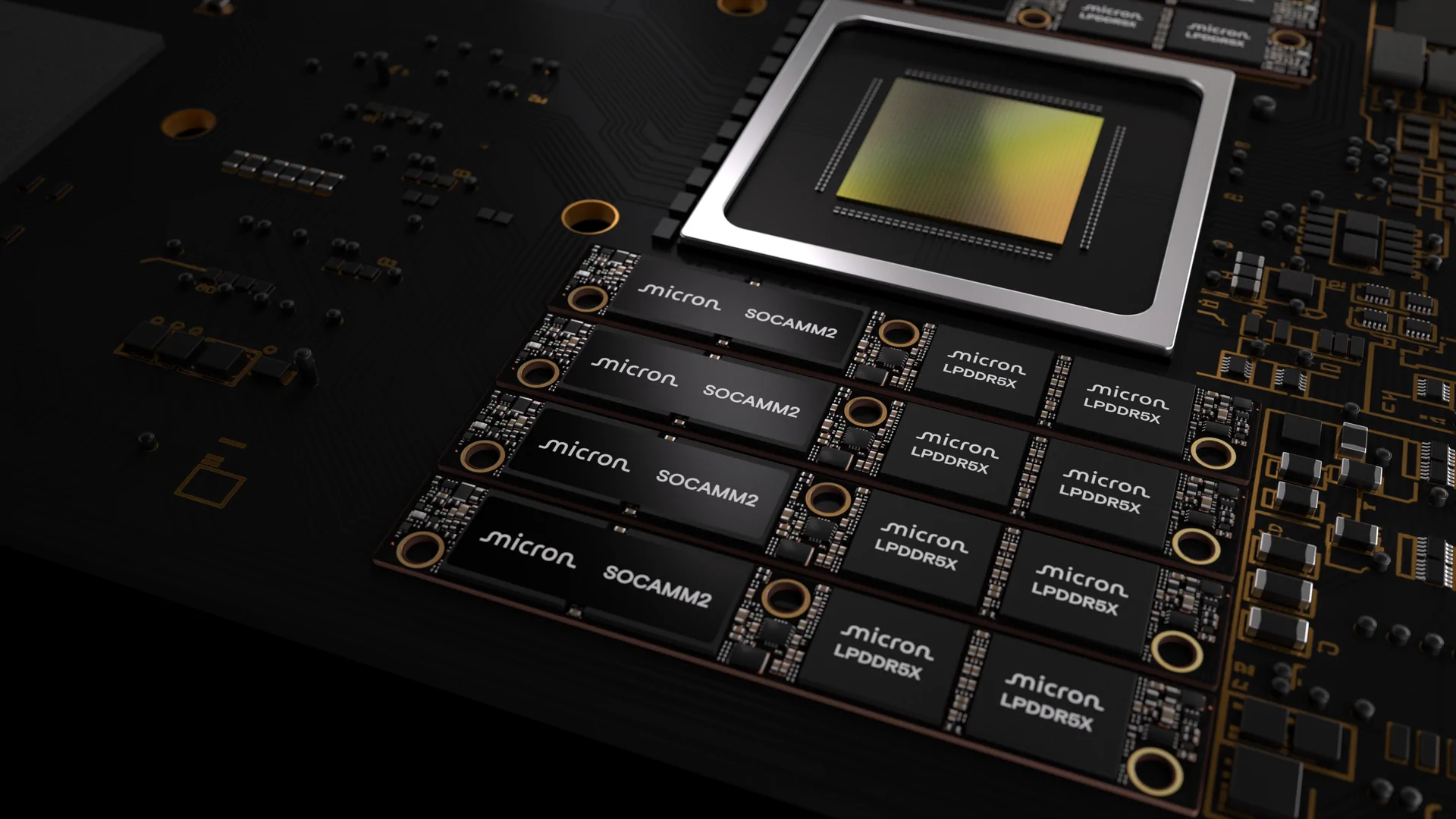

บริษัท ไมครอน เทคโนโลยี อิงค์ (Micron Technology, Inc.) ผู้นำในอุตสาหกรรมหน่วยความจำ ได้ประกาศความก้าวหน้าครั้งสำคัญเมื่อวันที่ 3 มีนาคม 2569 ด้วยการเริ่มส่งมอบตัวอย่างหน่วยความจำ LPDRAM SOCAMM2 ความจุ 256GB ให้แก่ลูกค้า นับเป็นก้าวสำคัญที่จะปฏิวัติประสิทธิภาพและการใช้พลังงานในโครงสร้างพื้นฐานของศูนย์ข้อมูลที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ (AI) และการประมวลผลประสิทธิภาพสูง (HPC) โดยนวัตกรรมนี้เกิดขึ้นได้จากการออกแบบชิป LPDDR5X ขนาด 32 กิกะบิตแบบโมโนลิธิกเป็นครั้งแรกของอุตสาหกรรม

หน่วยความจำ LPDRAM SOCAMM2 รุ่นใหม่นี้ได้รับการออกแบบมาเพื่อตอบสนองความต้องการที่เพิ่มขึ้นอย่างรวดเร็วของเวิร์กโหลด AI ที่ซับซ้อน เช่น โมเดลภาษาขนาดใหญ่ (LLM) ที่ต้องใช้หน่วยความจำจำนวนมากสำหรับพารามิเตอร์โมเดล หน้าต่างบริบทที่กว้างขวาง และแคช Key Value (KV) แบบถาวร ซึ่งเป็นสิ่งจำเป็นสำหรับการอนุมาน AI แบบเรียลไทม์ ด้วยความจุที่สูงขึ้นถึง 256GB ต่อโมดูล ทำให้สามารถติดตั้งหน่วยความจำ LPDRAM รวม 2TB ต่อซีพียูแบบ 8 แชนเนล ซึ่งจะช่วยให้ระบบรองรับเวิร์กโหลด AI ที่มีความต้องการสูงได้อย่างมีประสิทธิภาพมากยิ่งขึ้น

หนึ่งในจุดเด่นที่สำคัญของหน่วยความจำ LPDRAM SOCAMM2 คือการลดการใช้พลังงานและขนาดทางกายภาพได้อย่างมหาศาล เมื่อเทียบกับหน่วยความจำ RDIMM มาตรฐาน พบว่ามีการใช้พลังงานลดลงถึงสองในสามส่วน และมีขนาดเล็กลงถึงสองในสามส่วนเช่นกัน ซึ่งส่งผลให้ศูนย์ข้อมูลสามารถเพิ่มความหนาแน่นของแร็คเซิร์ฟเวอร์ และลดต้นทุนการเป็นเจ้าของ (TCO) โดยรวมได้อย่างมีนัยสำคัญ นอกจากนี้ ยังมอบประสิทธิภาพที่เหนือกว่าสำหรับงานประมวลผลหลัก โดยสามารถเพิ่มความเร็วในการตอบสนอง token แรกสำหรับการอนุมาน LLM แบบเรียลไทม์ได้มากกว่า 2.3 เท่า และเพิ่มประสิทธิภาพต่อวัตต์ได้มากกว่า 3 เท่าในแอปพลิเคชันซีพียูแบบสแตนด์อโลนสำหรับงาน HPC

การพัฒนาครั้งนี้สะท้อนให้เห็นถึงความมุ่งมั่นของไมครอนในการเป็นผู้นำด้านโซลูชันหน่วยความจำประหยัดพลังงานสำหรับเซิร์ฟเวอร์ โดยคุณราจ นาราซิมฮาน รองประธานอาวุโสและผู้จัดการทั่วไปหน่วยธุรกิจ Cloud Memory ของไมครอน ได้กล่าวเน้นย้ำถึงความสำเร็จด้านเทคโนโลยีและการบรรจุภัณฑ์ที่ทำให้สามารถส่งมอบโซลูชันหน่วยความจำแบบโมดูลาร์ที่มีความจุสูงสุด ใช้พลังงานต่ำที่สุด และมีขนาดเล็กที่สุดในอุตสาหกรรมได้สำเร็จ นอกจากนี้ ไมครอนยังได้ร่วมมืออย่างใกล้ชิดกับ NVIDIA ในการออกแบบหน่วยความจำที่ซับซ้อนสำหรับโครงสร้างพื้นฐาน AI ขั้นสูง ซึ่งคุณเอียน ไฟน์เดอร์ หัวหน้าฝ่ายผลิตภัณฑ์ซีพียูสำหรับศูนย์ข้อมูลของ NVIDIA ได้ชื่นชมความสำเร็จของไมครอนในการส่งมอบหน่วยความจำความจุสูงและแบนด์วิดท์สูงโดยใช้พลังงานน้อยกว่าหน่วยความจำเซิร์ฟเวอร์แบบดั้งเดิม

ด้วยข้อจำกัดด้านพลังงานและความร้อนที่เพิ่มขึ้นในสภาพแวดล้อมของศูนย์ข้อมูลสมัยใหม่ คุณลักษณะเฉพาะของ LPDRAM ที่รวมเอาประสิทธิภาพด้านความจุ แบนด์วิดท์ เวลาแฝง และการใช้พลังงานเข้าไว้ด้วยกัน ทำให้ LPDRAM กลายเป็นองค์ประกอบสำคัญสำหรับทั้งเซิร์ฟเวอร์ AI และเซิร์ฟเวอร์ประมวลผลหลัก โซลูชัน SOCAMM2 ยังมาพร้อมกับการออกแบบแบบโมดูลาร์ที่ช่วยเพิ่มความสะดวกในการบำรุงรักษา รองรับสถาปัตยกรรมเซิร์ฟเวอร์ระบายความร้อนด้วยของเหลว และเปิดทางสำหรับการขยายความจุในอนาคตตามความต้องการของ AI และการประมวลผลหลักที่เติบโตอย่างต่อเนื่อง

ไมครอนยังคงมีบทบาทสำคัญในการกำหนดมาตรฐาน JEDEC SOCAMM2 และทำงานร่วมกับนักออกแบบระบบเพื่อผลักดันการปรับปรุงประสิทธิภาพการใช้พลังงานและประสิทธิภาพโดยรวมสำหรับแพลตฟอร์มศูนย์ข้อมูลยุคหน้า ปัจจุบัน ไมครอนนำเสนอผลิตภัณฑ์ LPDRAM สำหรับศูนย์ข้อมูลที่หลากหลาย ตั้งแต่ส่วนประกอบขนาด 8GB ถึง 64GB และโมดูล SOCAMM2 ขนาด 48GB ถึง 256GB

ที่มา micron